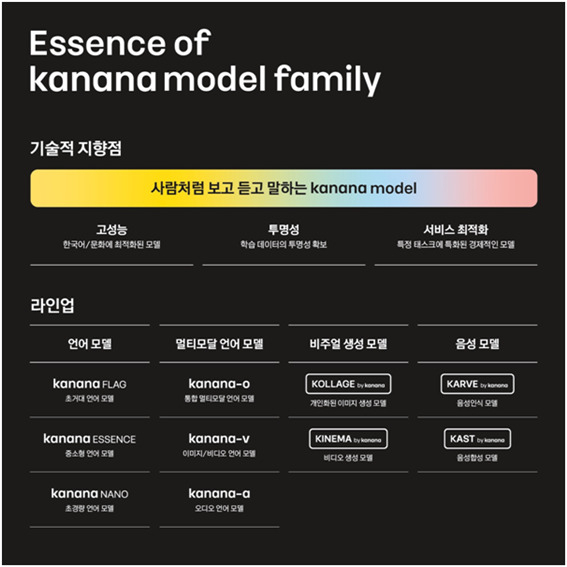

카카오가 통합 멀티모달 언어모델인 '카나나 o(Kanana o)'를 1일 공개했습니다. 카나나 o는 텍스트와 음성, 이미지를 동시에 이해하고 처리하는 점이 특징으로 꼽힙니다.

카카오는 통합 멀티모달 언어모델 '카나나-오(o)'가 한국어와 영어 벤치마크(성능 검증)에서 글로벌 최고 수준의 성능을 기록했다고 밝혔습니다.

카카오는 공식 기술(테크) 블로그를 통해 통합 멀티모달 언어모델 '카나나-오(o)'와 오디오 언어모델 '카나나-에이(a)'의 성능과 개발 후기를 공개하며 이같이 밝혔어요.

카나나-오(o)는 음성 감정 인식 기술을 통해 이용자의 의도를 올바르게 해석하고 상황에 맞는 적절한 반응과 답변을 제공합니다. 억양, 말투, 목소리 떨림 등 비언어적 신호를 분석하며 대화 맥락에 맞는 감정적이고 자연스러운 음성의 응답을 생성하는 것이 특징입니다.

특히 제주도, 경상도 등 지역 방언을 인식하고 이를 표준어로 변환해 자연스러운 음성을 만들 수 있답니다. 또 스트리밍 방식의 음성 합성 기술을 적용해 긴 대기 시간 없이 응답을 제공합니다. 예를 들어 이미지와 함께 “이 그림에 어울리는 동화를 만들어 줘”라고 입력하면 카나나-오(o)는 이 음성을 이해하고 이용자의 억양과 감정 등을 분석해 자연스럽고 창의적인 이야기를 실시간으로 생성해 들려줍니다.

또한 감정까지 이해하고 소통할 수 있는 AI 모델의 가능성을 입증했습니다. 카나나-오(o)는 이미지와 음성을 통합적으로 이해해야 하는 이미지-음성 질의응답(QA)에서도 강력한 성능을 달성하며 글로벌 경쟁력을 확인했습니다.

카카오는 향후 카나나-오(o)를 통해 △다중 턴(Multi-turn) 대화 처리 △양방향 데이터 동시 송수신 기술(Full-duplex) 대응 능력 강화 △부적절한 응답 방지를 위한 안전성 확보 등을 목표로 연구 개발을 지속할 계획이랍니다. 이를 통해 다중 음성 대화 환경에서의 이용자 경험을 혁신하고 실제 대화에 가까운 자연스러운 상호작용을 실현해 간다는 목표입니다.

카카오 관계자는 “카나나 모델은 복합적인 형태의 정보를 통합적으로 처리함으로써 기존의 텍스트 중심 AI를 넘어 사람처럼 보고 듣고 말하며 공감하는 AI로 진화하고 있다”며 “연구 결과 공유를 통해 국내 AI 생태계 발전에 꾸준히 기여할 계획”이라고 밝혔습니다.

최지호 기자 jhochoi@etnews.com